原创 学术头条 学术头条

想象一下,如果人工智能(AI)模型能像人脑一样,规模小,耗能少,但具备同样复杂功能,那现阶段 AI 模型训练的耗能大、难理解的瓶颈是不是就能解决了?

中国科学院自动化研究所李国齐、徐波研究员团队联合清华大学、北京大学等团队便在这一方面取得了突破——

他们借鉴大脑神经元复杂动力学特性,提出了“基于内生复杂性”的类脑神经元模型构建方法,而非基于 Scaling Law 去构建更大、更深和更宽的神经网络。这种方法不仅改善了传统模型通过向外拓展规模带来的计算资源消耗问题,还保持了性能,内存使用量减少了 4 倍,处理速度提高了 1 倍。

研究论文以“Network model with internal complexity bridges artificial intelligence and neuroscience”为题,发表在权威期刊 Nature Computational Science 上。共同通讯作者为中国科学院自动化所李国齐研究员、徐波研究员,北京大学田永鸿教授。共同一作是清华大学钱学森班的本科生何林轩(自动化所实习生),数理基科班本科生徐蕴辉(自动化所实习生),清华大学精仪系博士生何炜华和林逸晗。

李国齐解释说,构建更大、更复杂的神经网络的流行方法,称为“基于外生复杂性”,消耗了大量的能源和计算能力,同时缺乏可解释性。相比之下,拥有 1000 亿个神经元和 1000 万亿个突触连接的人脑仅需 20 瓦的功率即可高效运行。

加州大学圣克鲁斯分校 Jason Eshraghian 团队在评论文章中表示,这一发现暗示了 AI 发展的潜在转变。尽管大语言模型(LLM)的成功展示了通过大量参数计数和复杂架构的外部复杂性的力量,但这项新的研究表明,增强内部复杂性可能提供了改善 AI 性能和效率的替代路径。

他们还表示,AI 中的内部与外部复杂性之争仍然开放,两种方法在未来发展中都可能发挥作用。通过重新审视和深化神经科学与 AI 之间的联系,我们可能会发现构建更高效、更强大,甚至更“类脑”的 AI 系统的新方法。

效果怎么样?

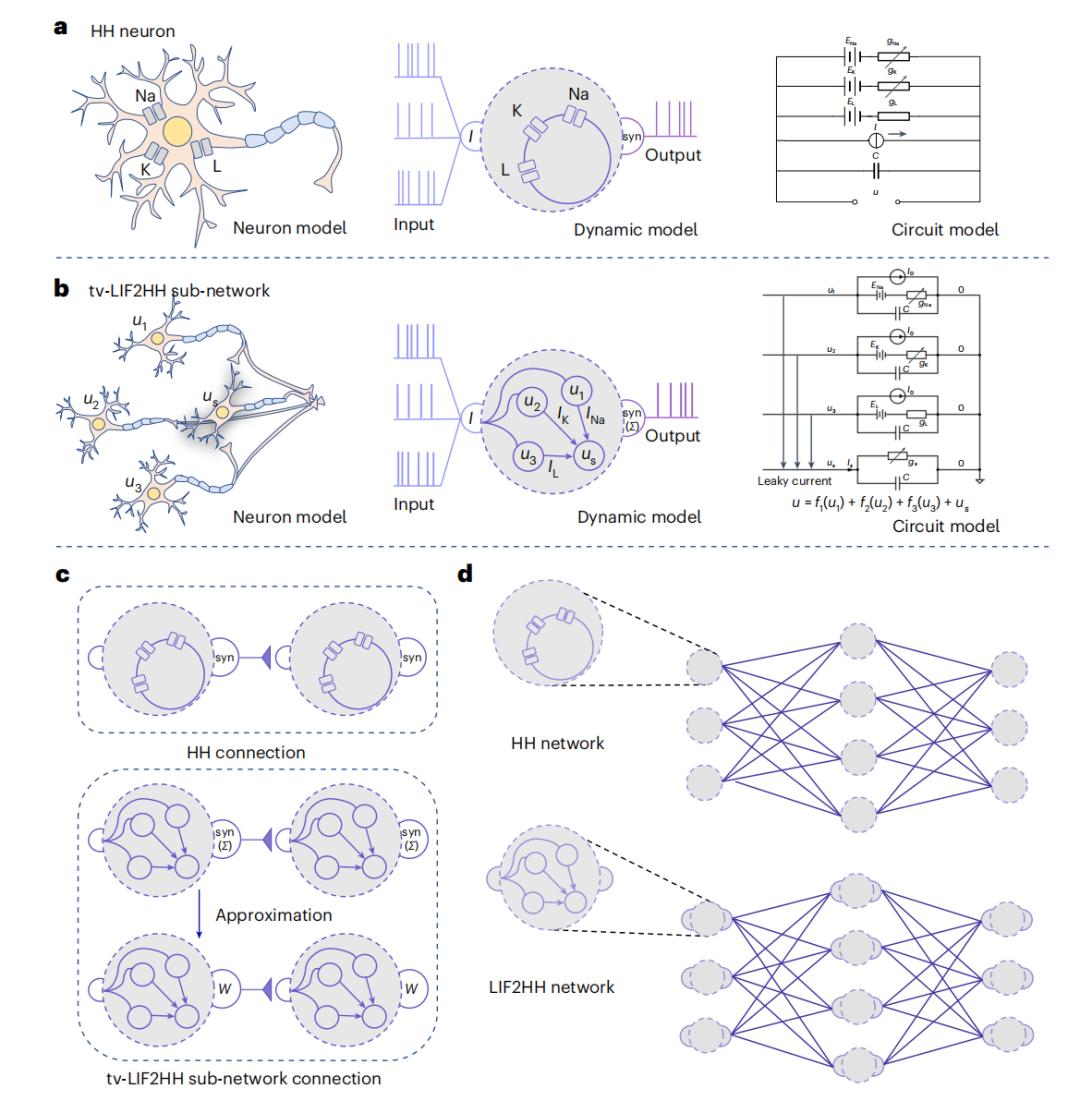

本研究首先展示了脉冲神经网络神经元 LIF(Leaky Integrate and Fire)模型和 HH(Hodgkin-Huxley)模型在动力学特性上存在等效性,进一步从理论上证明了 HH 神经元可以和四个具有特定连接结构的时变参数 LIF 神经元(tv-LIF)动力学特性等效。

基于这种等效性,团队通过设计微架构提升计算单元的内生复杂性,使 HH 网络模型能够模拟更大规模 LIF 网络模型的动力学特性,在更小的网络架构上实现与之相似的计算功能。进一步,团队将由四个 tv-LIF 神经元构建的“HH 模型”(tv-LIF2HH)简化为 s-LIF2HH 模型,通过仿真实验验证了这种简化模型在捕捉复杂动力学行为方面的有效性。

图|一种从 tv-LIF 过渡到 HH 的方法,它将外部连接的复杂性收敛到单个神经元的内部。

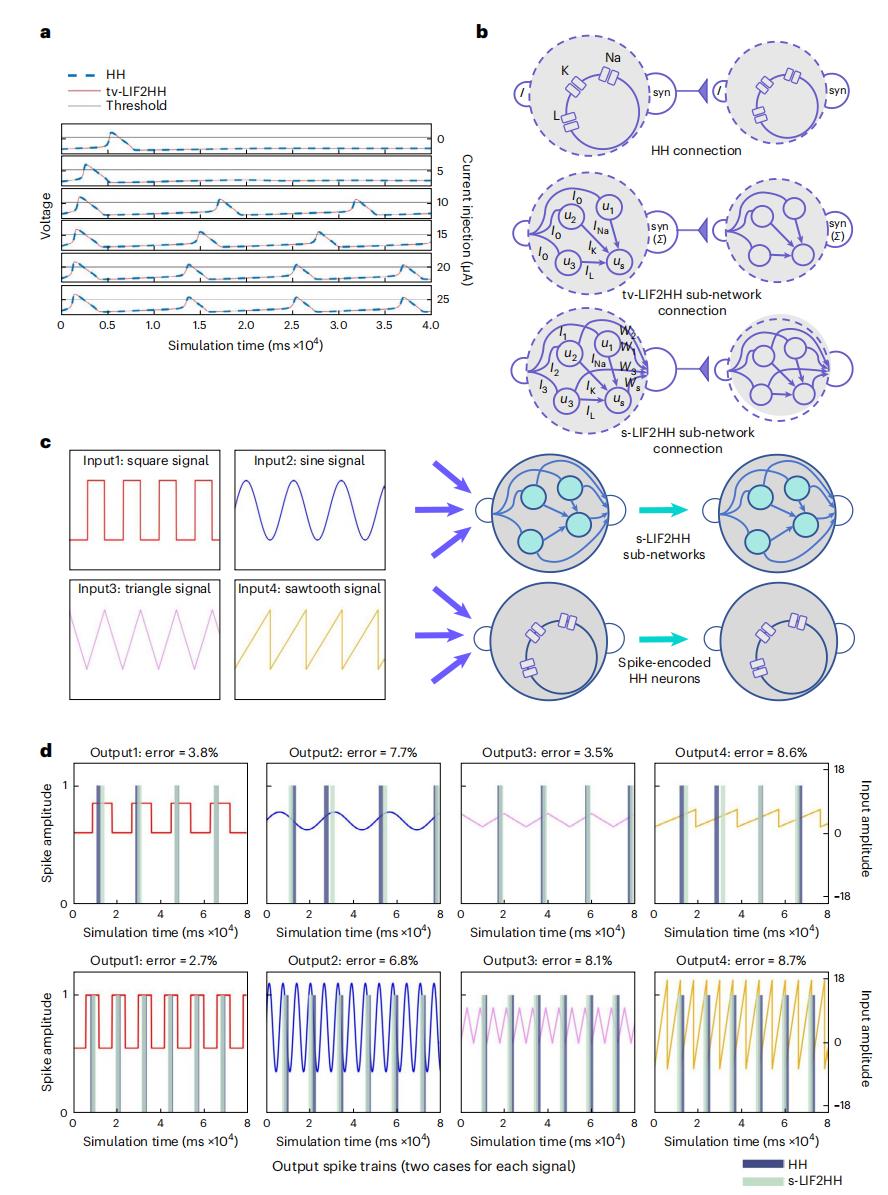

在多样化的输入下,s-LIF2HH 和 HH 网络的尖峰率和时间相似,尖峰活动的近似仍然存在,减少了计算成本并增强了生物可塑性,使得模型更适用于基于反向传播的训练。

对于方波、正弦波、三角波和锯齿波输入的平均相对误差分别为 3.3%,7.3%,5.8% 和 8.7%,均低于10%。这些不同输入下的结果确认了 s-LIF2HH 和 HH 模型产生了相似的尖峰计数,并且在发放时间上紧密对齐,展示了整体发放模式的相似性。这种普遍性意味着 HH 和 s-LIF2HH 模型之间的近似动力学在不同任务中持续存在。

图|高精度仿真案例的等效图。

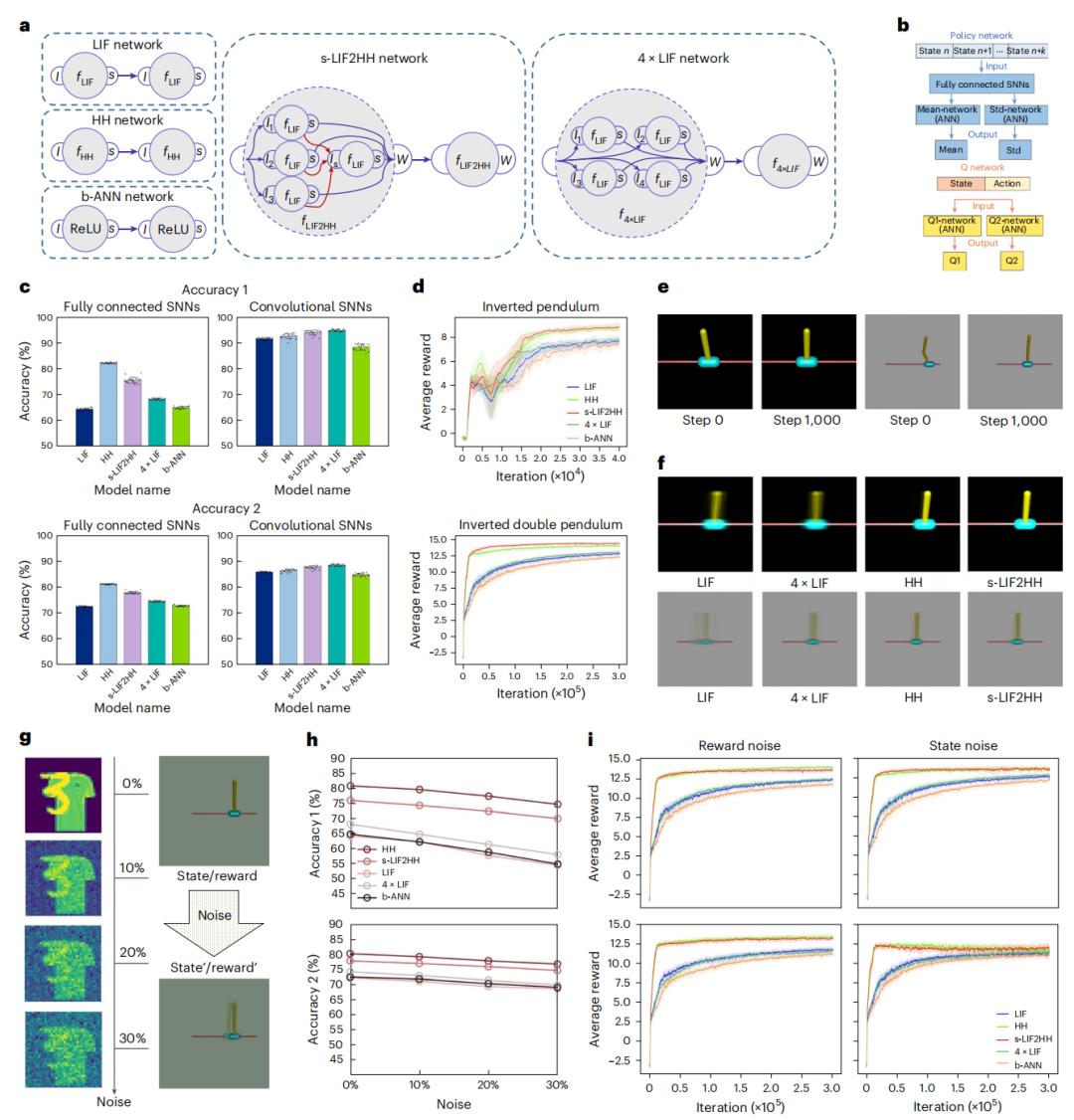

单个 HH 神经元的增强信息处理能力补偿了更简单的拓扑结构;因此,HH 神经元的内部复杂性与 s-LIF2HH 子网络的外部复杂性相当。具有更大内部复杂性的模型可以与具有更大外部复杂性的模型相匹配,而仅仅增加网络规模无法弥合这些与更简单模型之间的差距。

HH 和 s-LIF2HH 模型表现相似,都明显优于 LIF;4×LIF 略优于 LIF,而 b-ANN 略逊色但仍可比较。HH 和 s-LIF2HH 网络由于其复杂的结构,在时序信息提取方面具有强大的能力,这优于仅仅增加网络规模。

研究团队还进行了鲁棒性测试,以补充验证 HH 和 s-LIF2HH 网络的可比性。结果表明,HH 和 s-LIF2HH 网络具有相似的噪声鲁棒性,而鲁棒性源自 HH 神经元的动态复杂性和 s-LIF2HH 的复杂拓扑,而不仅仅是神经元数量。这表明,模型内部复杂性与外部复杂性之间具有等效性,并且它们在深度学习任务中比具有简单动力学增加规模的模型有更加明显的优势。

图|深度学习任务中的表征能力和鲁棒性。

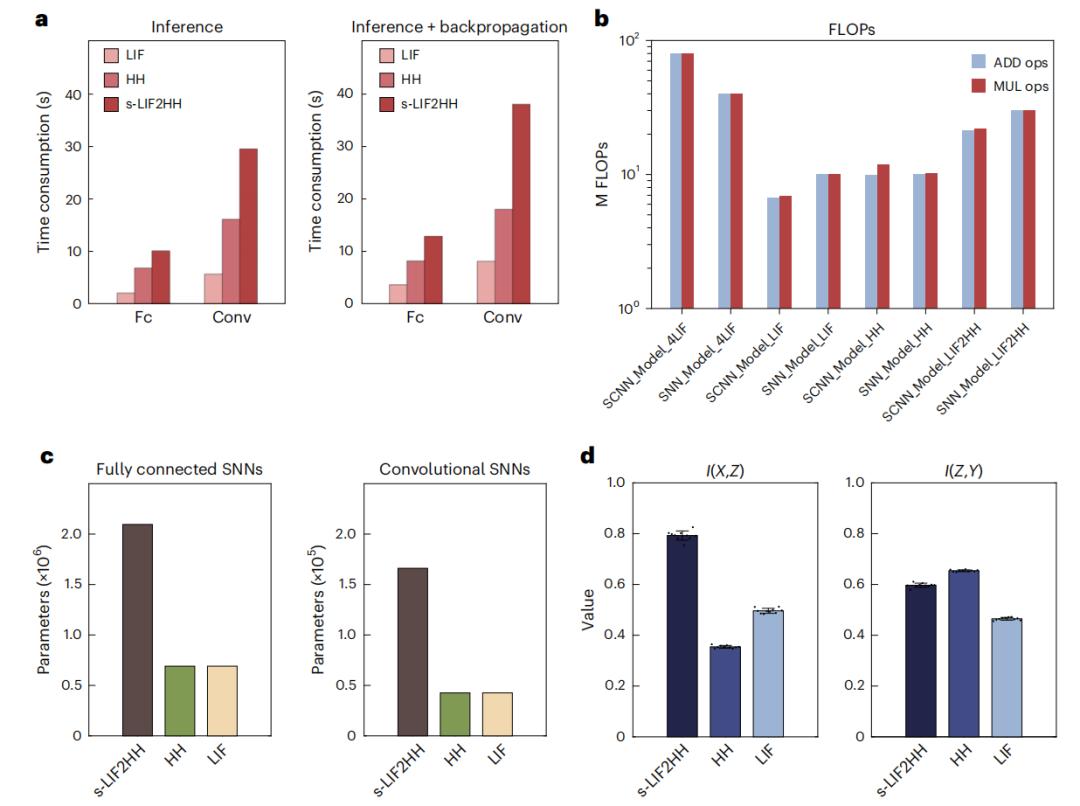

HH 网络的 FLOPs 高于 LIF 网络,但与相同结构的 s-LIF2HH 网络相比大约低 50%,这表明层间连接对总 FLOPs 的贡献大于神经元操作。HH 和 LIF 网络的可训练参数数量相同,而与 s-LIF2HH 网络相比,可训练参数数量大约减少 25%。

由于 HH 网络需要较少的计算,因此其时间消耗也相应较低。HH-fc 和 HH-conv 网络在推理过程中分别比 s-LIF2HH-fc 和 s-LIF2HH-conv 网络大约快 30% 和 45%,在训练过程中分别大约快 36% 和 52%。尽管 HH 和 s-LIF2HH 网络比 LIF 网络慢,但 HH 网络使用较少的计算资源,且比 s-LIF2HH 网络快。这些结果表明,与 s-LIF2HH 网络相比,HH 网络提供了显著的计算效率,证明了将外部复杂性转化为内部复杂性可以提高深度学习模型的效率。

图|计算资源和统计指标分析。

HH 网络的 I (X, Z) 与 LIF 网络相当,但远低于 s-LIF2HH 网络。相反,HH 网络的 I (Z, Y) 与 s-LIF2HH 网络相似,但优于 LIF 网络。这表明 HH 模型与 s-LIF2HH 模型相比具有较低的复杂性但相似的表示能力,与 LIF 模型相比具有类似的复杂性但更好的表示能力。

不足与展望

这项研究为构建更高效、更强大的 AI 系统提供了新的思路,并为将神经科学成果应用于 AI 研究提供了理论支持。

但是,研究也存在一定的局限性。例如,HH 和 s-LIF2HH 模型在深度学习实验中具有不同的脉冲模式,这表明模拟中近似的动态特性可能不是它们可比性的良好解释。这种现象可能源于它们基本单元(HH 神经元和 s-LIF2HH 子网络)固有的相似复杂性。

此外,由于神经元非线性和脉冲机制的局限性,本研究仅在小型网络中进行了,未来将研究更大规模的网络和单个网络中多种神经元模型的影响。

目前,研究团队已开展对更大规模 HH 网络,以及具备更大内生复杂性的多分支多房室神经元的研究,有望进一步提升大模型计算效率与任务处理能力,实现在实际应用场景中的快速落地。

内部复杂性小的模型方法可能为开发更高级和混合的 AI 提供了一条有希望的途径。未来,研究团队表示,他们希望更多研究人员关注复杂性这一主题,并利用神经科学的发现进行 AI 研究。